台灣人工智慧實驗室發布全球第一份民主國家協同操作年報,揭發資訊操弄者足跡與手法

台灣總統大選落幕,台灣人工智慧實驗室(Taiwan AI Labs)今(17)日發布「2024年台灣總統大選期間網路訊息操作分析報告」,這是在生成式AI元年全球第一個透過大型語言模型與多項人工智慧模型所完成的選舉操作的觀察報告。「2024年有許多國家舉行選舉,台灣是全世界境外訊息操作影響的指標國家,全球2024年第一個舉辦選舉的民主國家,也是第一個用AI技術觀察選戰資訊操弄的國家。」台灣人工智慧實驗室創辦人杜奕瑾17日在發布會上強調,「希望可以將台灣面臨資訊操弄的經驗與教訓,以及在台灣觀察到的生成式AI威脅,分享給其他民主國家參考。」期許台灣從自身開始,以「保障數位人權」的方式與概念,建立科技倫理立法機制,而非審查內容控制言論自由。台灣人工智慧實驗室今天的發布會共吸引超過100位國內外專家參與,包括多國駐台人員、國際知名媒體記者、國際組織在台代表、台灣官方代表、國內外相關領域研究者與學者、台灣非政府組織、與台灣各大主要媒體積極參與、討論,顯示國內外對此台灣大選與境外資訊操弄議題的高度關注。Infodemic 藉由協同帳號分析理解資訊操弄

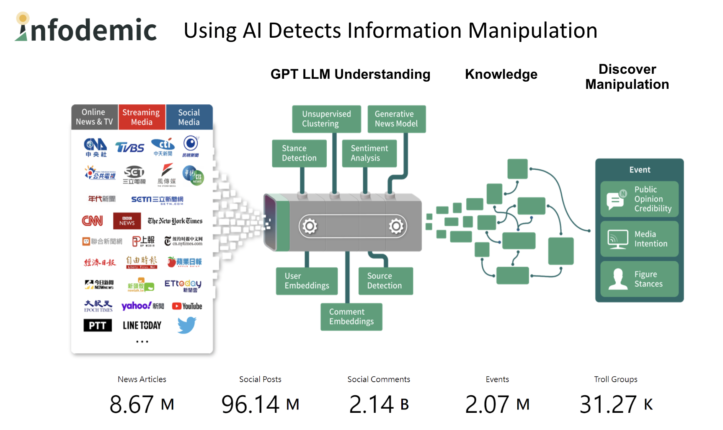

在疫情期間台灣人工智慧實驗室與國際發展可信任負責任的人工智慧醫療。同時面對全球疫情虛假訊息操作與全球合作夥伴建立相關偵察機制。台灣人工智慧實驗室創辦人杜奕瑾解釋,首先由AI觀察與理解各個帳號的行為發現協同帳號。協同群體帳號的定義是指一群非真正使用者的帳號。這些帳戶可能是過去「五毛」,即隨著官方需要發布特定內容的帳號;也可能是透過自動程式控制、或是公關公司的操作以非有機、組織性的方式在擴散特定言論。台灣人工智慧實驗室這兩年,藉由生成式科技大型語言模型理解網路數十億則社群媒體活動,挖掘出三萬多群協同團體,並在兩百多萬個議題中了解協同帳號在社交媒體操作的訊息內容,進而理解操作攻擊的對象與模式以達到揭露背後可能的目的。

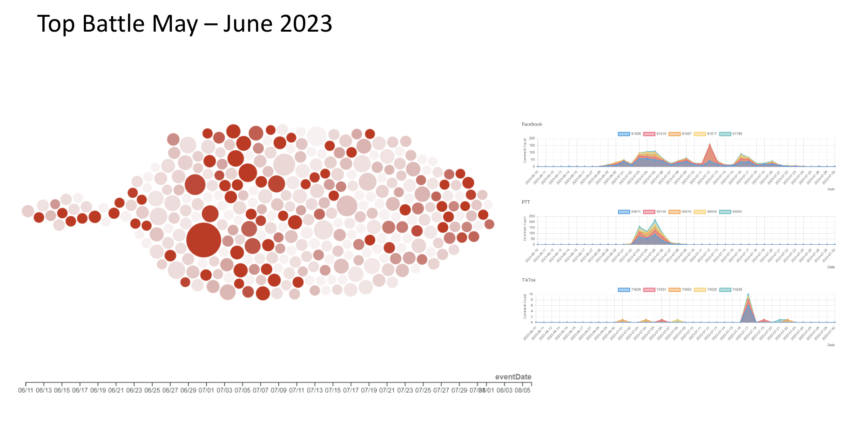

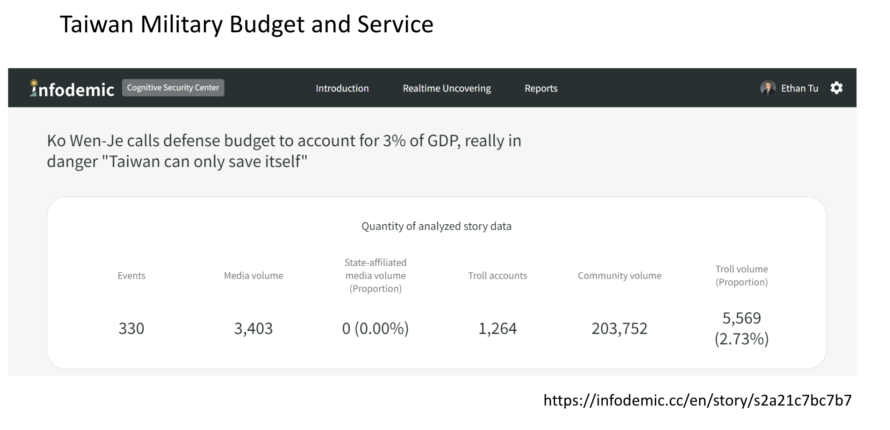

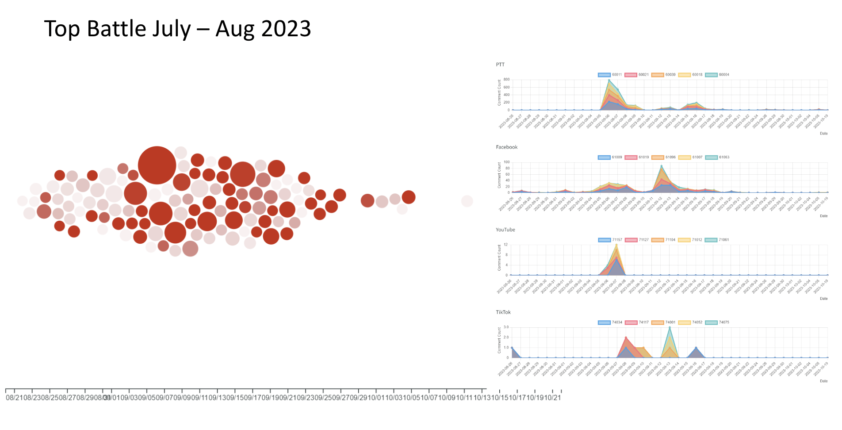

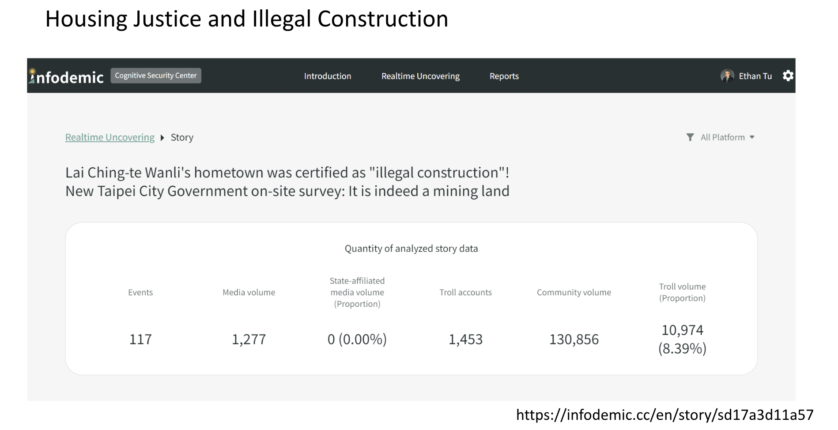

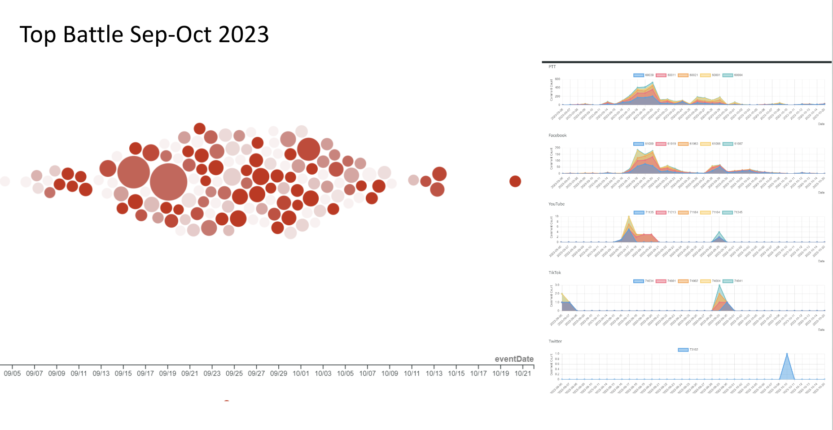

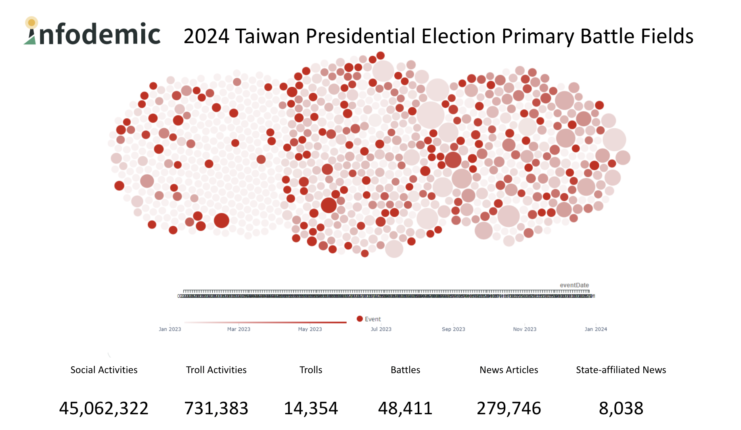

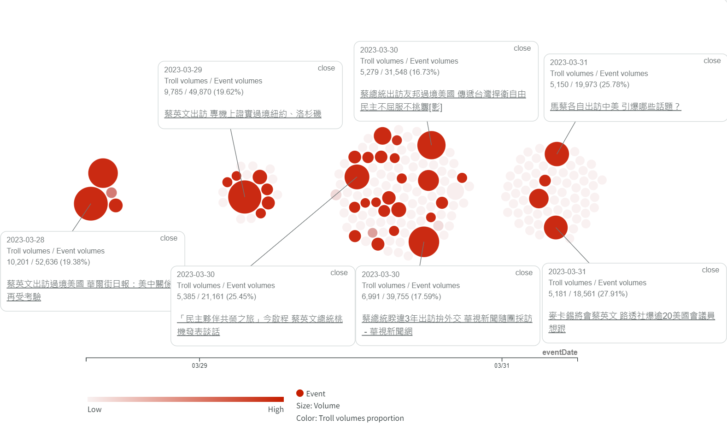

由於全球對訊息操作的需求增加,開始有國際夥伴對這個服務的需求,台灣人工智慧實驗室進一步把相關的技術能力建立成Infodemic平台。即時且全面的讓非技術的夥伴可以理解國內外資訊操弄情況,做為數位素養發展相關應對策略。台灣人工智慧實驗室內容執行長黃兆徽表示,該基金會近年來持續利用所開發的 Infodemic平台,觀察涵蓋Facebook、YouTube、X(Twitter)、TikTok與PTT等台灣主要社群平台協同行為。同時以大型語言模型理解訊息操作攻擊目標、主流媒體報導反應,及時紀錄協同團體所參與的訊息戰場,以及可能造成的影響力。大約從選前兩個月開始,則是每週舉行閉門會議,揭露所觀察到的網路資訊操弄狀況,與國內外學者專家交流討論;並在投票日後將選前一年的觀察心得分享給國際媒體、駐台外交人員、非政府組織和學研單位,共同設法提升大眾的媒體素養,建立認知韌性。除了給媒體與相關研究所需要的Infodemic平台。台灣人工智慧實驗室並提供了全面且安全的資訊接收平台-Miin,讓一般的使用者可以在接收到消息同時藉由人工智慧知道全面的觀點以及理解背後是否有訊息操作可能。台灣人工智慧實驗室創辦人杜奕瑾在會議中指出,由Infodemic平台上可以得知一年來台灣受到協同帳號影響的重要議題有哪一些。如圖所示,每個圓圈表示具有代表性的戰場,圓圈大小為議題影響,力而顏色深淺為協同群體的比例。

由於全球對訊息操作的需求增加,開始有國際夥伴對這個服務的需求,台灣人工智慧實驗室進一步把相關的技術能力建立成Infodemic平台。即時且全面的讓非技術的夥伴可以理解國內外資訊操弄情況,做為數位素養發展相關應對策略。台灣人工智慧實驗室內容執行長黃兆徽表示,該基金會近年來持續利用所開發的 Infodemic平台,觀察涵蓋Facebook、YouTube、X(Twitter)、TikTok與PTT等台灣主要社群平台協同行為。同時以大型語言模型理解訊息操作攻擊目標、主流媒體報導反應,及時紀錄協同團體所參與的訊息戰場,以及可能造成的影響力。大約從選前兩個月開始,則是每週舉行閉門會議,揭露所觀察到的網路資訊操弄狀況,與國內外學者專家交流討論;並在投票日後將選前一年的觀察心得分享給國際媒體、駐台外交人員、非政府組織和學研單位,共同設法提升大眾的媒體素養,建立認知韌性。除了給媒體與相關研究所需要的Infodemic平台。台灣人工智慧實驗室並提供了全面且安全的資訊接收平台-Miin,讓一般的使用者可以在接收到消息同時藉由人工智慧知道全面的觀點以及理解背後是否有訊息操作可能。台灣人工智慧實驗室創辦人杜奕瑾在會議中指出,由Infodemic平台上可以得知一年來台灣受到協同帳號影響的重要議題有哪一些。如圖所示,每個圓圈表示具有代表性的戰場,圓圈大小為議題影響,力而顏色深淺為協同群體的比例。

2024台灣總統大選期間的主要訊息操作戰場全都露

藉由Infodemic平台觀察2023年1月1日到報告發表時間截止,台灣人工智慧實驗室觀察到一萬四千多個協同帳號參與過四萬八千多個議題戰場,相關媒體報導27萬多則有八千多個官媒報導,73萬1383個協同帳號進行議題操作。在大選結束後,大約一半的不正常使用者帳號就消失了。

活動中觀察台灣一年多來的重大議題操作

1-4月

2023年1到4月相對選舉相關議題氣氛較低,其中最重要的事件是總統蔡英文訪美。積極的操作則在5月才開始啟動,且戰場越來越多。

5-6月

軍援與後續議題開始發酵。美國拜登總統5月表示要支持台灣防衛,當中可觀察到眾多協同帳號在挑撥台美關係,以及散播美國陰謀論。6月討論圍繞在台灣軍購預算,且台美雙方同時都被認知操作影響,想藉此混淆民眾的認知。當中南海工作會議也是其中一個大戰場。

7-8月

大型且具有影響力戰場相對密集出現,軍援影響可能對民眾無感,因此議題探究與人民最重要也直接影響的居住正義與違建。

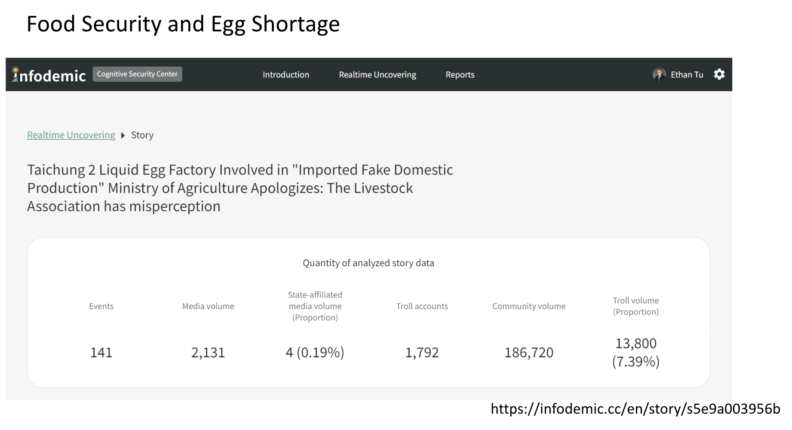

9-10月操作缺蛋與食安問題,此議題為協同團體操作的成功案例,三週議題操作與密集攻擊,便讓前農業部長陳吉仲下台。

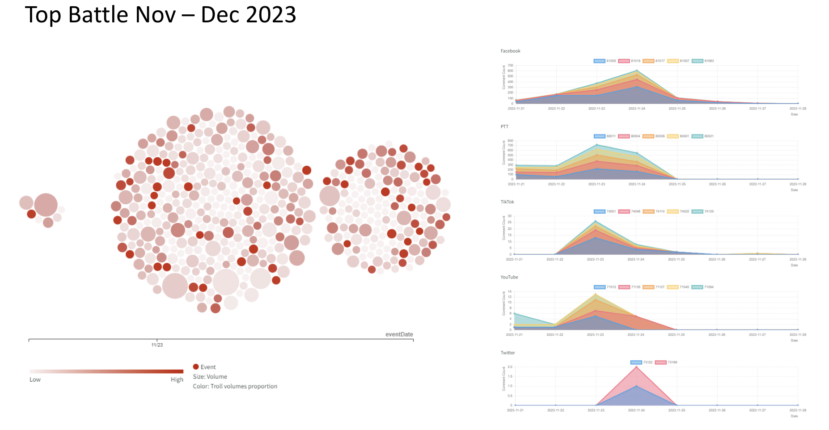

11-12月

選前戰場著重討論藍白合。協同團體藉由攻擊試圖促成藍白合,但此次對於協同團體是一個失敗的操作,藍白合並沒有成功。隨後協同團體便轉換立場攻擊其他候選人,此項操作不像台灣內部公關公司操作行為,且藍白雙方也可能不清楚此事件。因此從中便能發現疑似境外勢力介入的跡象。

2024年1月

到2024年1月選舉前,最大事件是日本地震與國防部發布的國家級警報。選前很明確的專攻某一個議題試圖影響台灣總統選舉,大選結束後約一半的協同帳號消失。直到美國代表團訪台後才又開始運作。

1-4月選舉相對冷清最大的議題戰場為蔡英文訪美。

5-6月美國與台灣國防軍事預算

7-8月台灣居住正義探討,違建議題不斷出現

9-10月缺蛋與食安問題操作,導致前農業部長下台

11-12月促成藍白合

台灣提供經驗對全球示警

台灣人工智慧實驗室提出警示,過去民主國家以為網路的便利以及科技的發展可以幫助民主與多元,但台灣的經驗反而提醒大家,全球在生成式科技的進步與社交媒體方便境外操作後,對數位人權的侵害以及境外操作民主情勢變得更加嚴峻。也呼應全球的數位人權以及民主指數,反而隨著科技的進步下降。在台灣人工智慧實驗室觀察2024年台灣大選的操作有十大需要特別警惕全球民主社會的觀察:

觀察1:生成技術已廣泛用於資訊操弄,文字誤導是最大戰場,闢謠不再有效

杜奕瑾表示由於事實查核已廣泛被接受。主要的問題不在於假消息而是誤導消息。文字的曲解敘事為大型語言模型參戰後的主要戰場。已觀察到大量文字生成曲解不對稱的宣傳。雖然文字本身並非造假。但透過大量不對稱的宣傳造成民眾喜惡的觀感。

雞蛋事件為例,利用少量的雞蛋短缺誤導民眾囤蛋。而快速生成新戰場的闢謠地獄讓官方闢謠不再有實質效果。

圖像生成已經用於輔助建立大量虛假帳號頭像。雖在選舉前有觀察到大量影片生成用於抹黑中,但實際影響效果有限。

觀察2:議題方向由少數幾個主導協同群體掌控

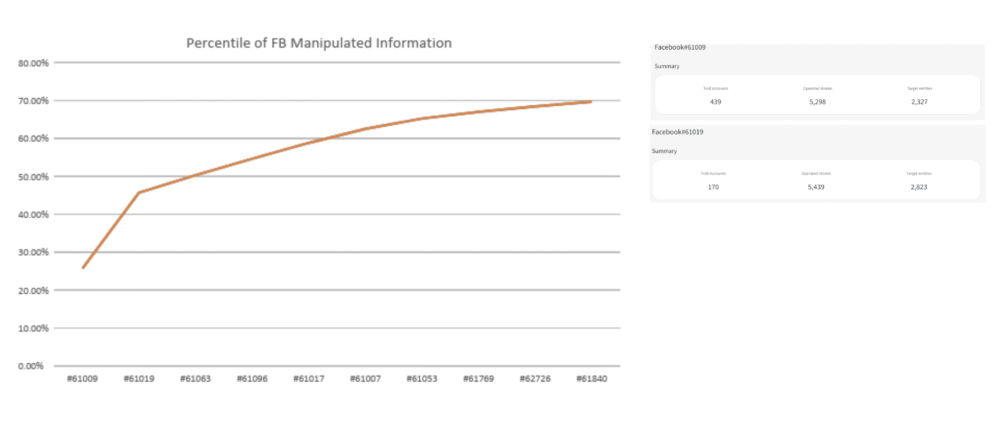

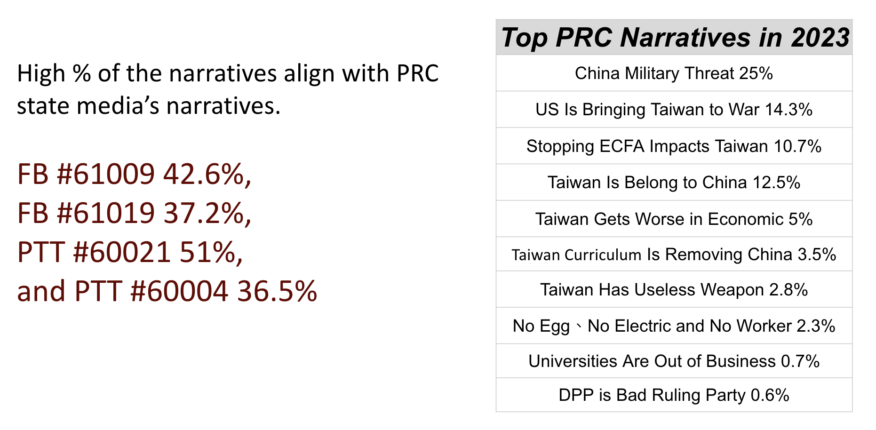

雖然有為數眾多的協同群體試圖帶動特定的風向與論述,裡面也包含台灣公關公司,但根據台灣人工智慧實驗室的觀察,只要掌握到少數幾個主導的協同操作群就可以控制主要的操作聲量。以Facebook在台灣人工智慧實驗室發現的前兩大協同群(#61009、#61019)為例,共626個帳戶創造的資訊操弄聲量在Facebook上的總資訊操弄聲量數就佔了45.71%。

觀察3:主流協同群並非台灣原生

台灣人工智慧實驗室杜奕瑾分析,主導操作輿論的協同團體帳戶群會同時以中

英文操作國內外的論述,除了以中文論述攻擊台灣政治人物,也以英文論述操作反美的議題,散播疑美論、抨擊美國總統拜登與美國外交策略。

從協同團體操弄帳號使用雙語、且攻擊各方政黨等跡象來看,這些協同團體帳 號的控制者並非來自台灣本土,同時就攻擊的方向與對象來說也不屬於特定政黨,其目的為散播混亂。這一類的操作手法常見於一些境外極權專制國家,目的是在民主國家傳播混亂,推動「獨裁比較有效率」的論述。

另外可見於美國軍援、台灣引進印度勞工,與日本災害救助。這些協同操作帳號遇到台灣友好的國家,會進一步積極抹黑攻擊,試圖製造輿論帶出不支持合作的假象。

最後以社群軟體上出現軍官海上浮屍的假消息為例,發現台灣社交媒體有大量帳號被盜現象,台灣人工智慧實驗室也藉由鼓勵帳號被盜的使用者報案去協助調查,由此可知,背後有人系統性的在社交媒體上盜取帳號,並經由進一步調查發現,這是透過以中國網通設備的後門漏洞做植入VPN為跳板,到社交媒體發表文章。綜合以上操作,不太像是台灣內部公關公司所為,已超出國內公關組織的能力。

觀察4:主流協同群與官媒有大量呼應

台灣人工智慧實驗室在Facebook發現的前兩大協同團體(#61009、#61019)為例,在2023年9月至12月期間以非自然的方式放大特定論述的聲量,值得注意的是,大量的論述呼應中國官媒的說法(下圖),包括「將台灣推向兵凶戰危險境」、「美國不顧台灣人死活」、「ECFA(兩岸經貿架構協議)終止影響台灣經濟」等。隨著大選接近,與官媒接近的論述也逐步增加,包括持續以戰爭恐嚇台灣,並加大攻擊台灣的教育與經濟問題。

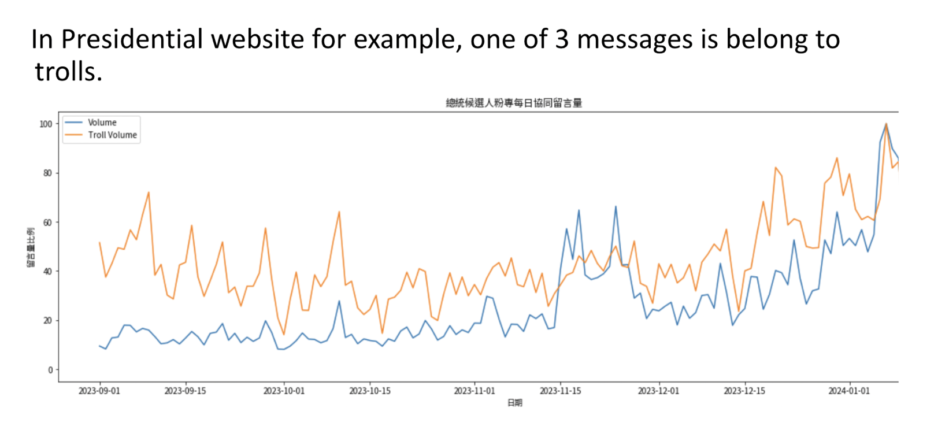

觀察5:主流協同群具有規模的影響台灣輿論並隨著影投票接近而增大

網路操作有很大的影響力,例如台灣總統候選人粉絲頁中,大約每六則內容就會看到一個是來自協同團體,尤其現任總統更多,幾乎每三則就有一則是來自協同團體。圖中藍色線為一般使用者,紅色線為協同團體,由圖表可以發現一般使用者的互動量本來並不高,但是會被協同團體的行為影響,進而也跟著風向增加互動量。

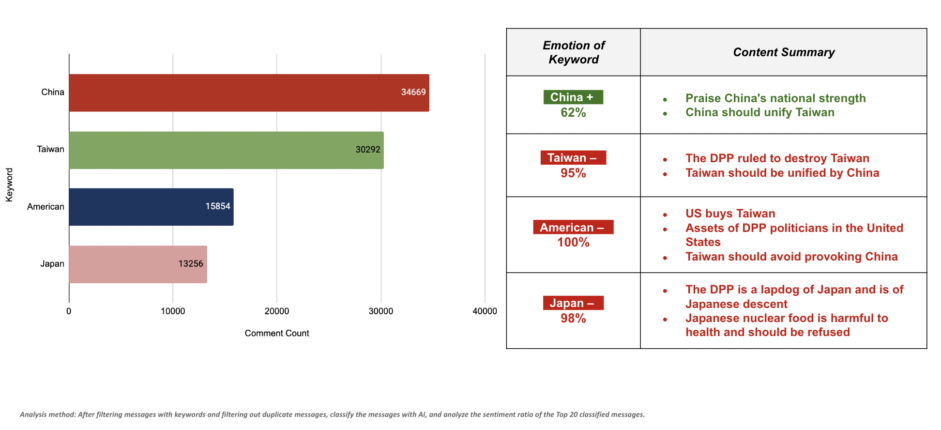

觀察6: 中資社群平台上的內容有國家支持偏見

台灣人工智慧實驗室也關注中資TikTok平台上的協同操作,發現監測期間的操弄言論主要在提及台灣、美國與日本時,絕大多數為負面論述;相較協同團體操作群提到中國的論述時,內容多數為正面,並且強力建立認知意象包括「讚揚中國武器強大」及「支持中國統一台灣」等。

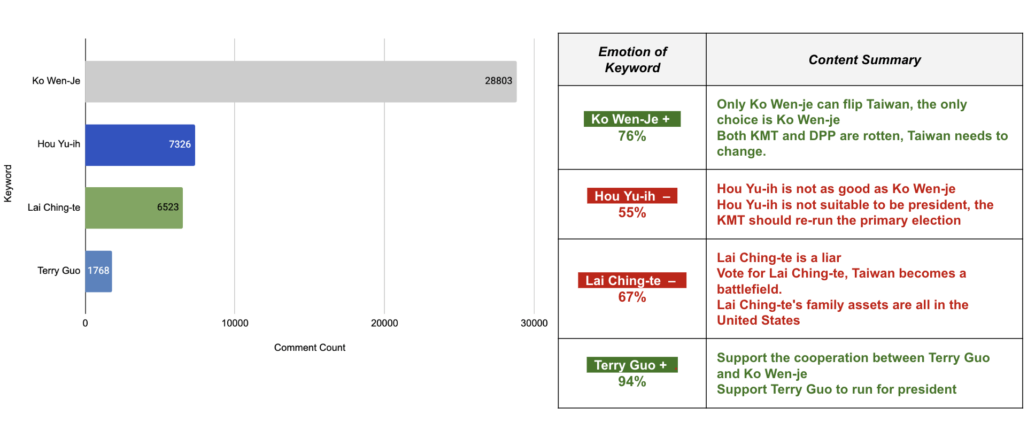

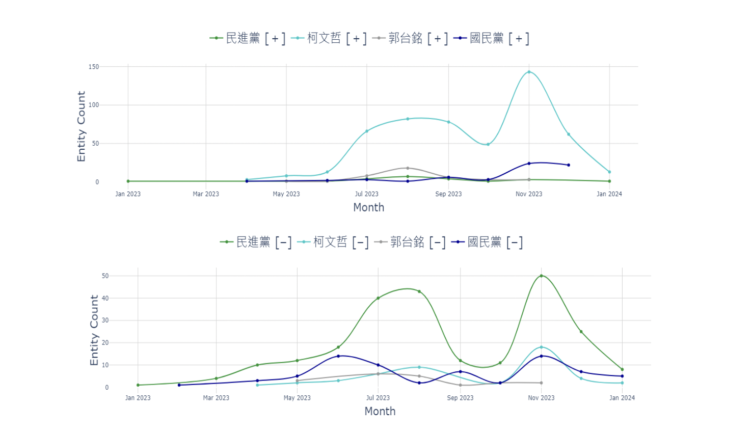

觀察7:中國平台候選人聲量如同已決定特定總統

相對於其他平台的協同團體對於各政黨皆有批評,不屬於特定政黨。TikTok

上的資訊操弄行為顯示有明確的政黨傾向,壓倒性支持台灣特定政黨民眾黨參選人。不只網路聲量主要集中在該名候選人身上,其論述多為正面,相較於其他兩大黨參選人的非自然網路聲量皆不到前述參選人的三成,且主要多為負面攻勢。

社交平台也開始影響民眾社群所見,無形中挑選觸及的貼文,讓民眾只能看到特定議題或內容。其中正向與負向也明顯不成比例,這與台灣其他平台或美國社交平台相比有很大的不對稱性。因此最近歐盟與美國皆在提倡人工智慧演算法的中立性,其演算法結果的中立性對於民主國家的影響是非常大。

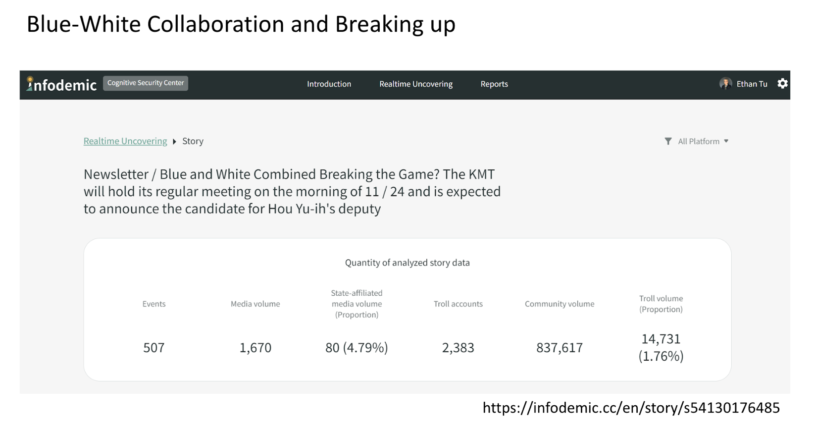

觀察8:主流協同群試圖主導政黨合作相關言論

平台也觀察到這一次在facebook上的兩個主要協同團體(#61009、#61019)在藍白合的議題上,明確的操作輿論影響某特定候選人與政黨,明顯且直接的企圖影響藍白合結果以達到此協同行為目的。

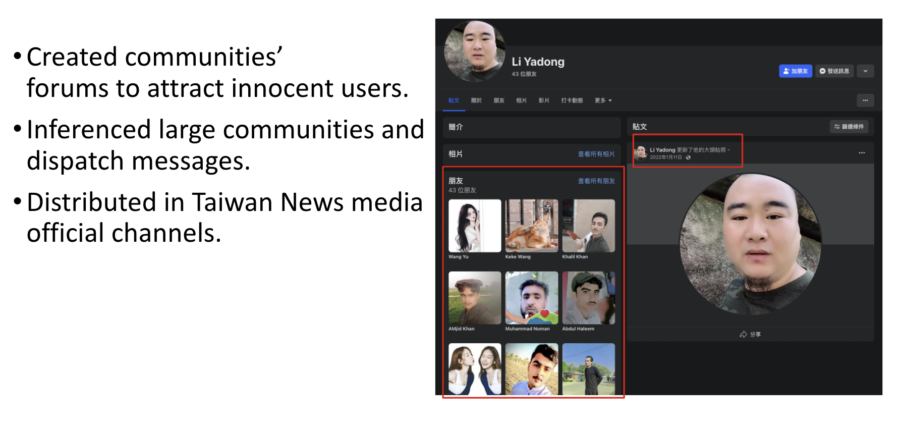

觀察9:網軍大量潛入社區校友社團,適時餵食

協同團體會佯裝身份創建論壇或朋友圈,例如地區社團、校友會、興趣社團等,藉此大型社群連結傳遞訊息,拉近與民眾距離,適時給予相關訊息與回應,進而影響使用者與控制議題,污染某些群體的內容,使其導向特定的方向與結果。這些協同團體也潛入分布在各個台灣新聞媒體的官方頻道裡。杜奕瑾提醒民眾在使用這些社交平台或粉絲頁時,需要隨時保持警覺,對於那些奇怪的言論與帳戶,可以適時的查核是否為社區真實的成員以及言論真實性。

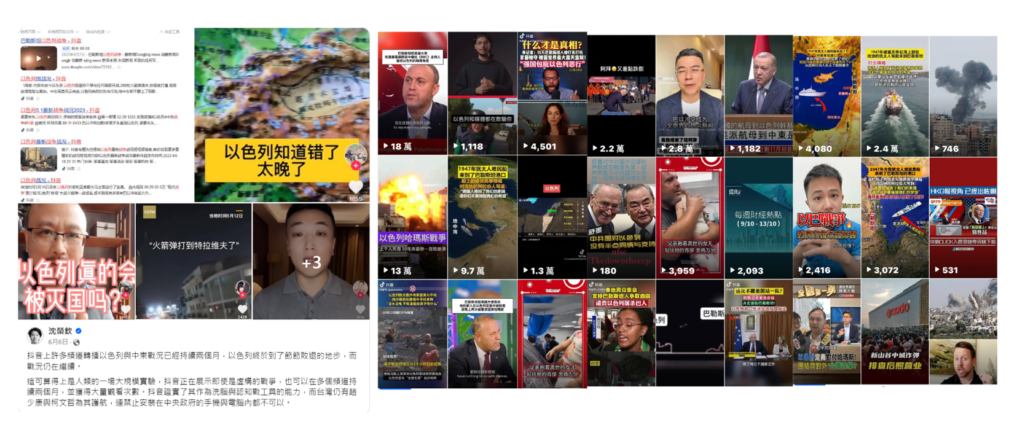

觀察10:短影音的影響成為一種趨勢

這次台灣總統大選中,短影音佔有很大的影響力。以哈衝突為例,tiktok上以哈衝突相關的短影音大量出現在各平台,用類似的內容重新創作成看似不同的影片,因此在網路上就會看到單一觀點的內容,導致大眾可能會對某一方會產生認知失衡。

另外值得注意的是,早在以哈衝突爆發前幾個月,這類短影音就已經在中資平台出現,虛構了兩國之間的衝突內容,且獲得了大量的瀏覽次數。因此可推斷背後有相關預算推動此認知操作,並透平台作為演練,並以平台使用者協助操作與散播不實訊息。

台灣人工智慧實驗室創辦人杜奕瑾指出,儘管這些資訊操作並非每一次都成功,但已在台灣造成一定的影響力;估計相關資訊操作觸及至少300萬台灣民眾。相關的資訊操弄行為在選舉前夕更顯著升溫。

關於Infodemic

Infodemic (https://infodemic.cc ) 是台灣人工智慧實驗室(Taiwan AI Labs)開發的網路監測工具,可以實時監控社群平台上的資訊,希望透過AI技術來揭露資訊操弄與協同行動、阻絕惡意假訊息的傳播,並辨識協同操作群的策略。

Infodemic平台利用人工智慧揭露信息操控,揭示協同行為,發現惡意信息的傳播,以及識別由協同帳戶團體使用的敘事策略。並透過提供認知安全掃描系統,企業可以驗證任何訊息,無論其格式如何,無論是URL、圖像、視頻,甚至是句子。只需輸入資料並啟動掃描,系統就會告知該資訊是否是社交媒體上的有機訊息,或者是否是由利用平台演算法操縱公眾認知的惡意行為者係統傳播的。一旦探測到協同活動,該平台將揭露並提供全面信息,展示網絡惡意行為者、隱藏的企圖、以及在互聯網和社交媒體平台上運作的機器人網絡的詳細見解。通過匯總的信息圖表,企業可以輕鬆掌握信息戰的複雜領域,並了解問題所造成的影響。此外,該系統可以連結與探究這些參與者和外國實體之間的任何潛在合作。

關於Taiwan AI Labs

台灣人工智慧實驗室 (https://ailabs.tw ) 以開放演算法、原始碼與聯合學習發展國際可信任的研發成果;整合台灣人才、半導體產業鏈優勢、和累積的龐大綜合健康醫療資料,推動智慧醫療、人機介面、生成式AI等領域的人工智慧發展。

Taiwan AI Labs積極推動台灣AI產業鏈成形,聯手政府部會和產業推動「聯合學習」,用共享模型取代共享資料,破產業間因為資料隱私等限制無法共享資料的壁壘,打造保障人權隱私、符合科技倫理並廣泛獲得國際認可的可信任AI技術。

在可信任AI的宗旨下,Taiwan AI Labs有效結合生成式AI,推出智慧醫療、 聯合學習、AI虛擬主播、未來場景生成攝影棚、新聞分析平台等解決方案。人機介面領域,發展AI音樂藝術生成及語音辨識、語意理解等技術,一大應用於現今最受世界關注之假訊息、假新聞操作議題,觀察資訊操作的脈絡,相關成果在國際間興起熱烈討論,並屢獲國際權威期刊認證及刊登。

台灣人工智慧實驗室的研究持續走在世界前沿,期望集結 AI 國家隊,整合人 才、資源、產業鏈,建立台灣聯合學習產業大聯盟,從公有雲與私有雲聯邦式 解決方案,推廣到全世界。

台灣人工智慧實驗室新聞聯絡人:江柔

手機: 0911967935

Email:jou.chiang@ailabs.tw